Vom Licht zum Bild

In der Fotografie dreht sich so ziemlich alles um das Thema Licht, wir rücken etwas ins richtige Licht, fotografieren bei schlechten Lichtverhältnissen, wählen die Belichtungszeit oder benutzen unterschiedliche Lichtquellen. Aber wie wird überhaupt aus Licht eine fotografische Abbildung?

Klar, zur Zeiten der Elektrotechnik weiß das natürlich jeder, durch den Bildsensor in der Kamera. Und wie das genau funktioniert versuchen wir euch hier verständlich zu erklären.

In den meisten Digitalkameras werden zur Zeit sog. APS-Sensoren (Active Pixel Sensor) verbaut. Grob gesagt, eine Ebene Fläche, besetzt mit Millionen kleiner Photodioden, welche jeweils noch mit einer kleinen Elektronik zur Spannungsverstäkung ausgestattet sind. Eine Photodiode ist ein elektrisches Bauteil, welches das Licht, das vom Objektiv auf den Sensor abgebildet wird, in eine bestimmte Spannung je nach Strahlungsintensität umwandelt. Mithilfe dieser Spannung weiß die Kamera also "wie viel Licht auf die Photodiode gefallen ist". Doch leider ist das erst die halbe Miete, unsere Augen können ja nicht nur hell/dunkel, sondern auch Farben sehen. Aber wie kriegt die Photodiode herraus welche Farbe das Licht, das auf sie fällt, hat? Die Antwort ist einfacher als man denkt - zunächst nämlich gar nicht.

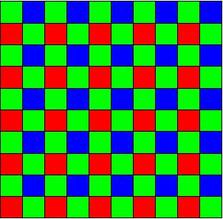

Doch für dieses Problem hat man eine einfache Lösung entwickelt. Es werden einfach Farbfilter vor die einzelnen Dioden gelegt, sodass nur Licht bestimmter Farbe auf die Diode fallen kann. Diese Farbfilter werden als sog. Bayer-Matrix bezeichnet.

Klar, zur Zeiten der Elektrotechnik weiß das natürlich jeder, durch den Bildsensor in der Kamera. Und wie das genau funktioniert versuchen wir euch hier verständlich zu erklären.

In den meisten Digitalkameras werden zur Zeit sog. APS-Sensoren (Active Pixel Sensor) verbaut. Grob gesagt, eine Ebene Fläche, besetzt mit Millionen kleiner Photodioden, welche jeweils noch mit einer kleinen Elektronik zur Spannungsverstäkung ausgestattet sind. Eine Photodiode ist ein elektrisches Bauteil, welches das Licht, das vom Objektiv auf den Sensor abgebildet wird, in eine bestimmte Spannung je nach Strahlungsintensität umwandelt. Mithilfe dieser Spannung weiß die Kamera also "wie viel Licht auf die Photodiode gefallen ist". Doch leider ist das erst die halbe Miete, unsere Augen können ja nicht nur hell/dunkel, sondern auch Farben sehen. Aber wie kriegt die Photodiode herraus welche Farbe das Licht, das auf sie fällt, hat? Die Antwort ist einfacher als man denkt - zunächst nämlich gar nicht.

Doch für dieses Problem hat man eine einfache Lösung entwickelt. Es werden einfach Farbfilter vor die einzelnen Dioden gelegt, sodass nur Licht bestimmter Farbe auf die Diode fallen kann. Diese Farbfilter werden als sog. Bayer-Matrix bezeichnet.

Bayer-Matrix

Bayer-Matrix

Diese Bayer-Matrix besteht vereinfacht aus vielen kleinen Quadraten, die ihrerseits wieder aus vier kleinen Quadraten bestehen, ein blaues, ein rotes und zwei grüne. Es werden jeweils zwei grüne Quadrate verwendet, weil die Farbe Grün in der Natur am häufigsten vorkommt und grün im menschlichen Auge am besten detektiert wird. Unter jedem Quadrat sitzt eine Photodiode. Da man aus den drei Grundfarben rot, grün und blau durch additive Farbmischung sämtliche Farben für das menschliche Auge darstellen kann, genügt es die Intensität dieser drei Farben zu messen, um ein Farbbild zu produzieren.

Ein Farbpixel in einem uns bekannten Farbbild besteht also meistens aus vier manchmal auch drei sogenannten Subpixeln, die die Grundfarben tragen. Das Licht für ein Farbpixel wird also durch mehrere (meist drei oder vier) Photodioden gemessen.

Ein Farbpixel in einem uns bekannten Farbbild besteht also meistens aus vier manchmal auch drei sogenannten Subpixeln, die die Grundfarben tragen. Das Licht für ein Farbpixel wird also durch mehrere (meist drei oder vier) Photodioden gemessen.

Da die beleuchteten Flächen, also die Flächen der einzelnen Dioden extrem klein sind, sind die durch den Lichteinfall entstehenden Spannungsunterschiede an den Photodioden ebenfalls sehr klein und müssen verstärkt werden. Dies geschieht für jede Diode einzeln durch den jeweiligen Verstärker, der ebenfalls auf dem Sensor untergebracht ist. Die ermittelten Werte werden dann von der Kamera für jedes Pixel ausgelesen und zu einem Bild zusammengefügt.

So, nun haben wir also die Daten für unser Bild gesammelt. Bleibt zum Schluss nur noch eine Thematik zu diskutieren: Warum benutzt man überhaupt einen APS-Sensor und gibt es Alternativen?

Eine alternative Sensorart ist der CCD-Sensor (charge-coupled device) der in vielen Videokameras und Kameras für die Astrofotografie seine Benutzung findet. Technisch gesehen gibt es nicht viele Unterschiede zwischen APS und CCD, die Anwendung entscheidet darüber, welche Art verbaut wird.

In Digitalkameras hat meist der APS den Vorzug, da er durch geringe Baukosten und Platzsparsamkeit durch die bereits integrierten Verstärker für jede einzelne Diode, punktet. Beim CCD werden die durch das einfallende Licht entstandenen Ladungen mehrerer Pixel mithilfe von einem Verstärker verarbeitet, was zu unerwünschten Überbelichtungen ganzer Pixelzeilen, sogenanntes "Blooming" führen kann, da die Ladungen erst von Pixel zu Pixel bis um Verstärker verschoben werden müssen. Wird nämlich ein Pixel überbelichtet, entstehen zu viele Ladungsträger, da aber nur eine begrenzte Anzahl aufgenommen werden kann, werden die überschüssigen an die Nachbarpixel weitergegeben.

Des weiteren kann die Digitalkamera die Pixel des APS schneller und flexibler auslesen, hilfreich für schnelle Bildraten, Videos oder schnelle Vorschaubilder, da jede Diode einzeln verstärkt wird und die Kamera nur noch jede Diode "abfragen" muss. Der CCD-Chip braucht für die Datenverarbeitung etwas länger, weil er wie bereits erwähnt, erst die entstandenen Ladungen zum Verstärker verschieben muss.

Der CCD-Sensor überliegt aber in Sachen Lichtempfindlichkeit, weshalb er auch speziell in der Astrofotografie gern genutzt wird, da die durch das Licht beleuchteten Photodioden größer gebaut werden können, weil keine zusätzlichen Verstärker auf dem Sensor untergebracht werden müssen. Außerdem neigt der APS-Sensor zu Farbrauschen, da es bei der Empfindlichkeit der Dioden und der Qualität der Verstäker immer zu fertigungsbedingten Unterschieden kommt, wodurch sich vorallem bei hohen ISO-Zahlen, sprich starker Verstärkung des Signals, diese Unterschiede durch Farbrauschen bemerkbar machen.

So, nun haben wir also die Daten für unser Bild gesammelt. Bleibt zum Schluss nur noch eine Thematik zu diskutieren: Warum benutzt man überhaupt einen APS-Sensor und gibt es Alternativen?

Eine alternative Sensorart ist der CCD-Sensor (charge-coupled device) der in vielen Videokameras und Kameras für die Astrofotografie seine Benutzung findet. Technisch gesehen gibt es nicht viele Unterschiede zwischen APS und CCD, die Anwendung entscheidet darüber, welche Art verbaut wird.

In Digitalkameras hat meist der APS den Vorzug, da er durch geringe Baukosten und Platzsparsamkeit durch die bereits integrierten Verstärker für jede einzelne Diode, punktet. Beim CCD werden die durch das einfallende Licht entstandenen Ladungen mehrerer Pixel mithilfe von einem Verstärker verarbeitet, was zu unerwünschten Überbelichtungen ganzer Pixelzeilen, sogenanntes "Blooming" führen kann, da die Ladungen erst von Pixel zu Pixel bis um Verstärker verschoben werden müssen. Wird nämlich ein Pixel überbelichtet, entstehen zu viele Ladungsträger, da aber nur eine begrenzte Anzahl aufgenommen werden kann, werden die überschüssigen an die Nachbarpixel weitergegeben.

Des weiteren kann die Digitalkamera die Pixel des APS schneller und flexibler auslesen, hilfreich für schnelle Bildraten, Videos oder schnelle Vorschaubilder, da jede Diode einzeln verstärkt wird und die Kamera nur noch jede Diode "abfragen" muss. Der CCD-Chip braucht für die Datenverarbeitung etwas länger, weil er wie bereits erwähnt, erst die entstandenen Ladungen zum Verstärker verschieben muss.

Der CCD-Sensor überliegt aber in Sachen Lichtempfindlichkeit, weshalb er auch speziell in der Astrofotografie gern genutzt wird, da die durch das Licht beleuchteten Photodioden größer gebaut werden können, weil keine zusätzlichen Verstärker auf dem Sensor untergebracht werden müssen. Außerdem neigt der APS-Sensor zu Farbrauschen, da es bei der Empfindlichkeit der Dioden und der Qualität der Verstäker immer zu fertigungsbedingten Unterschieden kommt, wodurch sich vorallem bei hohen ISO-Zahlen, sprich starker Verstärkung des Signals, diese Unterschiede durch Farbrauschen bemerkbar machen.